Anúncios

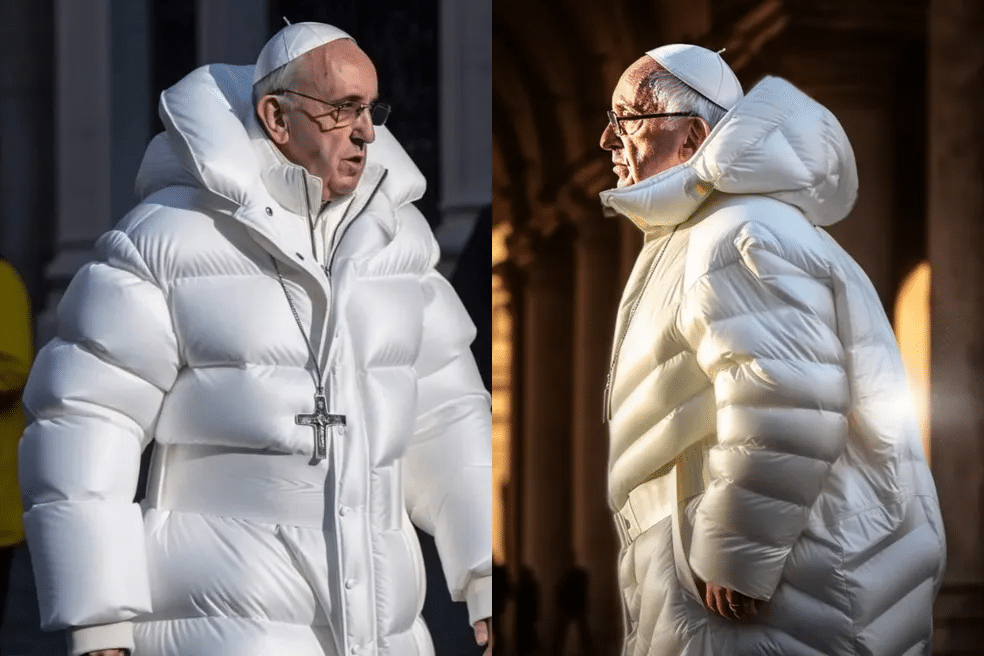

A inteligência artificial transformou a criação de conteúdo visual, mas trouxe desafios: como identificar se uma imagem ou vídeo é real ou gerado por IA?

Com o avanço exponencial das ferramentas de inteligência artificial generativa, distinguir conteúdos autênticos de criações sintéticas tornou-se uma necessidade urgente.

Anúncios

Deepfakes cada vez mais realistas, fotos hiper-realistas de pessoas inexistentes e vídeos manipulados circulam livremente nas redes sociais, gerando desinformação e comprometendo a confiança digital.

Felizmente, a mesma tecnologia que cria esses conteúdos também oferece soluções para detectá-los. Aplicativos especializados surgem como aliados fundamentais para jornalistas, criadores de conteúdo, profissionais de segurança digital e qualquer pessoa preocupada com a autenticidade das informações que consome e compartilha. 🔍

Anúncios

Por que detectar conteúdo criado por IA é essencial hoje?

A democratização das ferramentas de IA trouxe benefícios inegáveis, mas também abriu espaço para usos maliciosos. Vídeos deepfake podem difamar pessoas públicas, imagens falsas podem manipular eleições e conteúdos sintéticos podem ser usados em golpes financeiros sofisticados.

Segundo pesquisas recentes, mais de 90% das pessoas têm dificuldade em identificar imagens geradas por IA de alta qualidade apenas com o olhar humano. Essa vulnerabilidade coloca em risco não apenas indivíduos, mas empresas, instituições e até a democracia.

Aplicativos detectores funcionam como uma camada extra de segurança, analisando padrões invisíveis ao olho humano que denunciam a origem sintética do conteúdo. Eles examinam inconsistências nos pixels, anomalias em texturas, iluminação artificial e outros indicadores técnicos que revelam a intervenção de algoritmos.

Como funcionam os aplicativos detectores de IA? 🤖

Esses aplicativos utilizam tecnologia de aprendizado profundo para identificar “impressões digitais” deixadas por algoritmos generativos. Cada ferramenta de IA possui características únicas em como processa imagens e vídeos, criando padrões identificáveis.

O processo geralmente envolve múltiplas camadas de análise. Primeiro, o aplicativo examina metadados do arquivo, verificando informações sobre câmera, software de edição e histórico de modificações. Em seguida, analisa características visuais como gradientes de cor, simetria facial, textura de pele e coerência de iluminação.

Modelos avançados também avaliam aspectos temporais em vídeos, detectando inconsistências entre frames, movimentos faciais não naturais e descontinuidades na sincronização labial. Alguns aplicativos chegam a comparar o conteúdo com bancos de dados conhecidos de imagens geradas por IA.

Técnicas de detecção mais comuns

- Análise de ruído digital: imagens reais contêm padrões de ruído específicos das câmeras, ausentes em criações sintéticas

- Detecção de artefatos: algoritmos deixam rastros como distorções em bordas, anomalias em reflexos e texturas irrealistas

- Verificação de consistência física: checagem de leis físicas como gravidade, perspectiva e comportamento da luz

- Análise de características biométricas: identificação de padrões faciais impossíveis ou movimentos oculares não naturais

- Fingerprinting de modelos: reconhecimento de assinaturas específicas de ferramentas como DALL-E, Midjourney ou Stable Diffusion

Principais aplicativos para detectar fotos e vídeos feitos por IA 📱

O mercado oferece diversas soluções, desde ferramentas profissionais até aplicativos acessíveis para usuários comuns. Cada um possui pontos fortes específicos dependendo do tipo de conteúdo analisado.

ForgeSpy – Detector de IA intuitivo e eficiente

O ForgeSpy se destaca pela interface amigável e pela precisão na detecção de conteúdos sintéticos. Desenvolvido especificamente para identificar imagens e vídeos criados por inteligência artificial, o aplicativo utiliza algoritmos de última geração para analisar múltiplos aspectos do conteúdo visual.

O grande diferencial está na velocidade de análise e na capacidade de processar diferentes formatos de arquivo. Em poucos segundos, o aplicativo fornece um relatório detalhado indicando a probabilidade de o conteúdo ser gerado por IA, apontando áreas específicas que apresentam inconsistências.

Além disso, o ForgeSpy é constantemente atualizado para reconhecer as novas gerações de modelos generativos, mantendo-se eficaz mesmo contra as ferramentas de IA mais recentes. A versão gratuita oferece funcionalidades robustas, enquanto o plano premium adiciona análises em lote e relatórios técnicos aprofundados.

Outras ferramentas disponíveis no mercado

Embora o ForgeSpy seja uma opção destacada, outros aplicativos também merecem menção. Ferramentas baseadas em blockchain verificam a procedência de imagens através de certificados digitais, enquanto soluções corporativas oferecem APIs para integração em sistemas de moderação de conteúdo.

Plataformas como Sensity AI e Reality Defender focam especificamente em deepfakes de vídeo, analisando movimentos faciais frame por frame. Já ferramentas acadêmicas como o Detector desenvolvido pelo MIT concentram-se em pesquisa e oferecem resultados altamente técnicos para profissionais especializados.

Sinais visuais que você pode observar sem aplicativos 👀

Enquanto a tecnologia de detecção avança, desenvolver um olhar crítico ainda é fundamental. Alguns indicadores podem ser percebidos com atenção cuidadosa, especialmente em conteúdos gerados por modelos mais antigos ou configurações menos refinadas.

Observe cuidadosamente as mãos nas imagens – historicamente, representam um desafio para algoritmos de IA. Dedos extras, posições anatômicas impossíveis ou proporções estranhas frequentemente denunciam origem sintética. O mesmo vale para orelhas, dentes e acessórios como óculos.

Fundos com padrões repetitivos anormais, textos ilegíveis ou distorcidos, e elementos que desafiam a física (como sombras inconsistentes ou reflexos impossíveis) também são sinais reveladores. Em vídeos, preste atenção especial ao piscar dos olhos e à sincronia labial durante a fala.

Checklist rápido de verificação visual

- Cabelos e fios individuais apresentam realismo ou parecem “pintados”?

- A textura da pele mostra poros, imperfeições naturais e variações de tom?

- Os olhos possuem reflexos naturais e movimentos coerentes?

- Objetos no fundo mantêm proporções corretas e perspectiva consistente?

- Há textos legíveis ou todos aparecem borrados/nonsense?

- Joias, botões e detalhes pequenos estão bem definidos?

- A iluminação vem de uma fonte consistente e cria sombras realistas?

Desafios na detecção de conteúdo gerado por IA 🎯

A corrida entre criação e detecção de conteúdo sintético é constante. À medida que detectores se tornam mais sofisticados, os geradores de IA também evoluem, incorporando técnicas para mascarar suas características identificáveis.

Modelos adversariais generativos (GANs) são treinados especificamente para enganar detectores, criando um ciclo de aprimoramento mútuo. Cada nova geração de ferramentas como DALL-E, Midjourney ou Stable Diffusion corrige imperfeições que versões anteriores apresentavam, dificultando a identificação.

Além disso, a combinação de conteúdo real com elementos sintéticos – técnica chamada de “inpainting” – cria híbridos extremamente difíceis de detectar. Uma foto real pode ter apenas um rosto substituído por IA, mantendo todo o restante autêntico e dificultando análises automáticas.

Implicações éticas e legais do conteúdo sintético ⚖️

A proliferação de conteúdo gerado por IA levanta questões complexas sobre autenticidade, propriedade intelectual e responsabilidade. Quem responde quando um deepfake causa danos à reputação? Como proteger direitos autorais de imagens que serviram de treinamento para IAs?

Diversos países começam a desenvolver legislações específicas. A União Europeia incluiu requisitos de transparência no AI Act, exigindo que conteúdos sintéticos sejam claramente marcados. Nos Estados Unidos, estados como Califórnia e Texas já criminalizam deepfakes maliciosos, especialmente em contextos eleitorais e pornográficos.

No Brasil, o tema ainda caminha para regulamentação mais robusta, mas já existem discussões sobre enquadrar a criação maliciosa de conteúdo sintético em crimes como difamação, estelionato ou perturbação da ordem pública, dependendo do contexto e intenção.

O futuro da verificação de autenticidade digital 🔮

Especialistas preveem que a solução de longo prazo envolverá sistemas de certificação digital desde a origem. Câmeras e smartphones futuros poderiam incorporar blockchain ou criptografia para autenticar imagens no momento da captura, criando uma “cadeia de custódia” verificável.

Organizações como a Coalition for Content Provenance and Authenticity (C2PA) trabalham em padrões universais para metadados de autenticação. Grandes empresas de tecnologia como Adobe, Microsoft e Google já começam a implementar essas especificações em seus produtos.

Paralelamente, a educação digital se torna essencial. Ensinar o público a questionar a autenticidade do conteúdo, verificar fontes e utilizar ferramentas de detecção será tão importante quanto as próprias tecnologias de verificação.

Dicas práticas para se proteger de conteúdo sintético enganoso 🛡️

Adote uma postura de ceticismo saudável diante de conteúdos surpreendentes ou emocionalmente intensos. Antes de compartilhar, faça uma busca reversa de imagem usando ferramentas como Google Imagens ou TinEye para verificar se o conteúdo aparece em contextos diferentes.

Considere a fonte da informação. Perfis recém-criados, contas sem histórico consistente ou páginas sem verificação oficial devem acender alertas. Conteúdos virais merecem verificação extra, especialmente se tiverem implicações políticas, financeiras ou sociais significativas.

Mantenha aplicativos detectores instalados em seu dispositivo e use-os regularmente, especialmente antes de compartilhar conteúdo importante. Combine a análise tecnológica com seu próprio julgamento crítico – a ferramenta mais poderosa ainda é uma mente questionadora e informada.

Checklist de segurança digital contra desinformação

- Verifique sempre a fonte original antes de compartilhar conteúdo impactante

- Use ferramentas de busca reversa de imagens para rastrear a origem

- Instale e utilize aplicativos detectores de IA confiáveis

- Questione conteúdos que provocam reações emocionais intensas

- Confira se veículos de imprensa reconhecidos cobriram o assunto

- Observe detalhes visuais suspeitos antes de aceitar algo como verdadeiro

- Eduque familiares e amigos sobre os riscos de conteúdo sintético

- Denuncie deepfakes maliciosos às plataformas e autoridades competentes

Como escolher o melhor aplicativo detector para suas necessidades 🎯

A escolha ideal depende do seu perfil de uso. Profissionais de jornalismo e fact-checking precisam de ferramentas com relatórios detalhados e alta precisão, enquanto usuários comuns beneficiam-se mais de interfaces simples e resultados rápidos.

Considere se você precisa analisar principalmente imagens estáticas ou vídeos, pois algumas ferramentas especializam-se em um formato específico. Avalie também o volume de análises necessário – para uso intenso, planos pagos com processamento em lote podem ser mais econômicos.

Verifique a reputação do desenvolvedor, a frequência de atualizações e se o aplicativo é transparente sobre suas metodologias. Ferramentas que explicam como chegaram às conclusões tendem a ser mais confiáveis que aquelas que apenas fornecem percentuais sem contexto.

A importância da literacia digital na era da IA generativa 📚

Nenhuma tecnologia de detecção substituirá completamente o pensamento crítico humano. A educação digital precisa evoluir para incluir compreensão sobre como IAs criam conteúdo e quais são suas limitações e potenciais de uso indevido.

Escolas, universidades e instituições devem incorporar módulos sobre verificação de autenticidade em seus currículos. Compreender o básico sobre como funcionam modelos generativos capacita as pessoas a identificarem sinais de manipulação e tomarem decisões informadas sobre o conteúdo que consomem.

A responsabilidade também recai sobre plataformas digitais, que devem implementar sistemas de verificação e rotulagem de conteúdo sintético. A transparência sobre a origem das imagens e vídeos precisa tornar-se padrão, não exceção, no ecossistema digital.

Aplicativos detectores como ferramentas de empoderamento 💪

Longe de serem apenas recursos defensivos, aplicativos detectores de IA representam uma democratização do acesso à verificação de autenticidade. Ferramentas que antes estavam disponíveis apenas para organizações especializadas agora cabem no bolso de qualquer pessoa com um smartphone.

Essa acessibilidade transforma cidadãos comuns em verificadores ativos, criando uma rede distribuída de checagem que dificulta a propagação massiva de desinformação. Quando milhões de pessoas podem instantaneamente verificar a autenticidade de um conteúdo viral, a janela de oportunidade para manipulação se reduz drasticamente.

Além disso, a própria existência dessas ferramentas funciona como elemento dissuasor. Sabendo que conteúdos sintéticos podem ser facilmente detectados, potenciais criadores de deepfakes maliciosos enfrentam riscos maiores de exposição e consequências legais.

Integrando detectores de IA no seu fluxo de trabalho digital 🔄

Para profissionais que lidam regularmente com conteúdo visual, incorporar ferramentas de detecção na rotina é essencial. Jornalistas devem verificar imagens antes de publicações, empresas precisam autenticar materiais recebidos de terceiros, e educadores devem confirmar a originalidade de trabalhos estudantis.

Estabeleça protocolos claros: qualquer conteúdo de fonte não verificada deve passar por análise antes de uso ou compartilhamento. Crie bibliotecas de referência com exemplos de detecções bem-sucedidas para treinar equipes e aprimorar o olhar crítico coletivo.

Mantenha-se atualizado sobre novas ferramentas e técnicas de detecção. O campo evolui rapidamente, e o que funciona hoje pode tornar-se obsoleto amanhã. Participe de comunidades online focadas em verificação de autenticidade e compartilhe experiências com outros profissionais.

Perspectivas finais sobre autenticidade na era digital 🌐

Vivemos um momento histórico onde a linha entre real e sintético torna-se progressivamente mais tênue. Essa realidade não é necessariamente distópica – a IA generativa oferece possibilidades criativas extraordinárias quando usada eticamente e com transparência.

O desafio está em desenvolver simultaneamente as tecnologias de criação e detecção, mantendo sempre a transparência como princípio fundamental. Conteúdos sintéticos não são intrinsecamente problemáticos; o problema surge quando são apresentados como autênticos com intenção de enganar.

Aplicativos detectores de IA representam uma peça fundamental nesse quebra-cabeça, mas funcionam melhor quando combinados com educação digital, regulamentação apropriada e cultura de verificação. A responsabilidade pela integridade do ecossistema informacional é compartilhada entre desenvolvedores, plataformas, reguladores e cada usuário individual.

Ao equipar-nos com ferramentas adequadas e conhecimento crítico, podemos navegar essa nova realidade mantendo a confiança nas informações visuais que moldam nossa compreensão do mundo. O futuro da autenticidade digital depende das escolhas que fazemos hoje sobre como criamos, compartilhamos e verificamos conteúdo. ✨